Длинные треды с Claude: как победить дрейф контекста

Почему Claude деградирует в длинных диалогах и как с этим бороться: context rot, /compact, handoff-промпты и другие рабочие техники.

Длинные треды с Claude: как победить дрейф контекста

Вы открываете новый чат с Claude, формулируете задачу — и первые 10–15 ответов просто блестящие: точные, структурированные, на нужном уровне детализации. Потом что-то меняется. Модель начинает повторять мысли, игнорировать ваши ранние инструкции, давать расплывчатые рекомендации вместо конкретных. Кажется, будто перед вами уже другой Claude.

Это не баг и не случайность. У явления есть название — context rot (контекстное гниение) — и против него есть конкретные приёмы. В этой статье разберём механику проблемы и покажем систему, которая реально работает.

Что такое context rot и почему Claude «дрейфует»

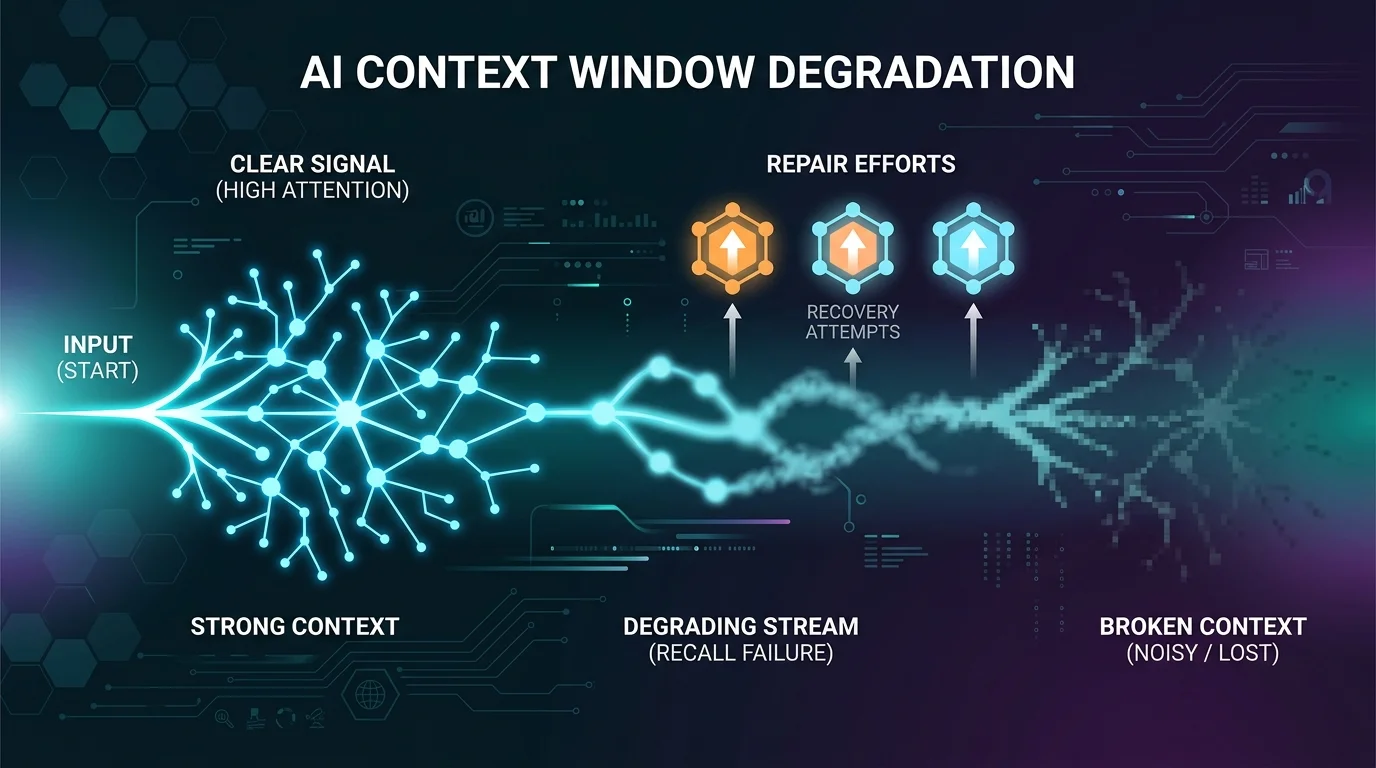

Context rot — это постепенная деградация качества вывода AI-агента по мере того, как контекстное окно заполняется в ходе длинной сессии.

«Контекстное окно» — это весь текст, который языковая модель может использовать при генерации ответа. Это её «рабочая память», а не долгосрочное хранилище.

Контекстное окно — это всё, что Claude «видит» в данный момент: каждое ваше сообщение, каждый ответ модели, каждый прочитанный файл, результаты вызовов инструментов — всё это занимает место.

Механика деградации работает так:

По мере того как контекстное окно заполняется историей разговора, инструментами и загруженными файлами, соотношение сигнал/шум падает. Агент с трудом находит и соблюдает ранние инструкции, начинает противоречить сам себе и выдаёт результаты всё худшего качества. Это не баг — это структурное следствие того, как LLM обрабатывают информацию в рамках фиксированного контекстного окна.

Каждый ответ агента становится частью контекста для следующего. Если агент допускает небольшую ошибку или отклоняется в начале, эта ошибка «запекается» в контексте. Будущие ответы строятся поверх неё. Ошибки не просто сохраняются — они накапливаются.

Даже при большом контекстном окне его не стоит заполнять до краёв. Производительность деградирует по мере заполнения, причём по-разному: когда окно заполнено менее чем на 50%, модель «теряет» токены из середины; когда более 50% — начинают вытесняться самые ранние токены.

graph TD

A[🟢 Начало сессии

Чёткие инструкции, высокое качество] --> B[📈 Накопление токенов

История диалога растёт]

B --> C[⚠️ 50–65% заполнения

Начало незаметной деградации]

C --> D[🔴 Context Rot

Повторы, игнорирование инструкций,

противоречия]

D --> E1[🔄 /compact или handoff

Компрессия контекста]

D --> E2[🆕 Новая сессия

Чистый старт с резюме]

E1 --> F[✅ Восстановление качества]

E2 --> F

Симптомы: как понять, что дрейф уже начался

Проблема context rot коварна тем, что не приходит внезапно. Деградация происходит постепенно — и именно это делает её трудно заметной.

Способность Claude сигнализировать о потере контекста незаметна, но уловима. По мере роста треда ответы становятся менее конкретными, модель повторяет уже заданные вопросы или возвращается к обобщённым шаблонам.

Вот чеклист ранних признаков drift:

| Симптом | Что происходит на самом деле |

|---|---|

| Claude переспрашивает то, что вы уже объяснили | Ранние инструкции вытеснены из «активного» внимания |

| Ответы стали более общими и менее точными | Сигнал «тонет» в шуме накопленного контекста |

| Модель противоречит своим же прошлым выводам | Ошибки первых сообщений компаундируются |

| Claude игнорирует ограничения, заданные в начале | Ранние токены вытеснены более поздними |

| Форматирование «поехало», стиль изменился | Правила стиля потеряли вес в окне внимания |

Техника 1: Проактивная компрессия с /compact

Первый и самый мощный инструмент — команда /compact в Claude Code.

Claude Code включает команду /compact, которая сжимает историю переписки в сжатое резюме. Вместо того чтобы хранить каждое сообщение дословно, она уменьшает разговор до более короткого представления, сохраняющего ключевые решения, факты и контекст.

Главное правило — использовать /compact до деградации, а не после.

Лучший момент для компрессии — около 60% заполнения контекста, до того как качество начнёт снижаться. При 60% Claude ещё имеет полный, несжатый доступ ко всему в сессии, и создаваемое резюме основано на полной информации. При 80–95% модель уже работает с частичным или сжатым контекстом, и её резюме отразит эту деградацию.

Решение — проактивное управление контекстом: использовать /compact до того, как окно переполнится, а не после.

Всегда добавляйте инструкции к команде /compact. Укажите Claude, что именно нужно сохранить: архитектурные решения, активные баги, ограничения, имена файлов. Без этого автокомпрессия просто усредняет всё подряд.

Пример: /compact Сохрани: (1) структуру модулей, (2) договорённость использовать TypeScript strict mode, (3) открытый баг с авторизацией в auth.ts

Обратная ошибка — пытаться сохранить так много, что компрессия не даёт реального эффекта. Если инструкция по сохранению занимает три абзаца, вы, скорее всего, включаете лишнее. Стремитесь к кратким, высокоинформативным инструкциям — максимум 5–10 пунктов.

Техника 2: Summary handoff — «передача эстафеты»

Для работы в claude.ai (веб-интерфейс), где нет /compact, ключевая техника — summary handoff: осознанный перезапуск сессии с компактным резюме.

По мере роста диалога Claude вынужден обрабатывать всю историю с каждым новым сообщением. Это означает, что ваше 100-е сообщение теоретически стоит значительно больше с точки зрения лимитов, чем первое.

Алгоритм handoff-перезапуска:

# Шаблон handoff-промпта

Попроси Claude (в старом треде):

"Создай компактное резюме нашей работы для переноса в новый чат.

Включи:

- Цель задачи и текущий статус

- Ключевые решения и договорённости

- Открытые вопросы и следующий шаг

- Важные ограничения и контекст

Объём: не более 300 слов."

Затем открой новый чат и начни его с:

"Продолжаем работу. Вот контекст: [вставь резюме]

Следующий шаг: [конкретная задача]"

Антропик и независимые эксперты рекомендуют «компрессию контекста» как лучшую практику: когда диалог приближается к лимиту окна, нужно свести текущее состояние проекта в одно высококачественное якорное сообщение и продолжить с него. Это не только сохраняет ключевые детали, но и освобождает место для новой работы.

«Context engineering — это самый важный навык, который вы можете развить сегодня. Забудьте о промптах — с этим справится каждый.»

Техника 3: Структурные приёмы — Projects и Reference-файлы

Вместо того чтобы бороться с деградацией по факту, можно выстроить систему, которая минимизирует её появление.

Используйте Projects в claude.ai

Это профессиональные практики эффективной работы с AI: использование Projects для организации работы, артефактов для разделения результатов от процесса, чекпоинтов для фиксации состояния, Skills для упаковки процедурных знаний. Это хорошие практики вне зависимости от размера контекстного окна.

Создайте Reference-документ (ваш «якорь»)

Важно понимать, что определённые типы информации — такие как конкретные числа, списки параметров или правила форматирования — особенно уязвимы к вытеснению. Пользователи, работающие с регуляторными требованиями или многошаговыми задачами, получают выгоду от создания кратких, обновляемых «блоков состояния проекта», которые можно повторно вводить в диалог при обнаружении дрейфа.

Пример минимального reference-блока:

## PROJECT ANCHOR (вставляй при каждом новом треде)

**Проект:** [название]

**Стек:** [технологии]

**Текущий модуль:** [что делаем]

**Стиль кода:** [правила]

**Нельзя:** [жёсткие ограничения]

**Статус:** [что готово, что нет]

Декомпозиция задач на короткие сессии

Разбивайте крупные задачи. Короткие, сфокусированные сессии с чёткими передачами результата превосходят марафонские сессии, которые накапливают тысячи токенов «шума».

Начинайте новые чаты чаще вместо одного мега-треда, и делайте промпты очень конкретными.

Неправильно: один огромный тред «Помоги мне написать, отредактировать и опубликовать мою статью»

Правильно:

- Тред 1: структура и тезисы → сохранить outline.md

- Тред 2: черновик раздела 1 (передать outline.md)

- Тред 3: редактура и стиль (передать черновик + style guide)

- Тред 4: финальная проверка (передать финальный текст)

Техника 4: Ветвление и чекпоинты

Для сложных исследовательских задач, где нужно «пробовать разное», помогает техника ветвления.

Аналогия с контролем версий здесь идеальна: у вас есть основная ветка диалога. Вы можете отпочковаться, исследовать, учиться, а затем вернуться к основной ветке и включить полученные знания — не сохраняя всё исследование.

Когда вы хотите попробовать другой подход с определённой точки в диалоге, не теряя основного треда, в новых версиях Claude Code есть нативный форкинг: команда /fork создаёт ответвление от текущей сессии прямо внутри разговора.

Сравнение стратегий управления контекстом

| Стратегия | Когда применять | Сложность | Эффект |

|---|---|---|---|

/compact | Claude Code, ~60% заполнения | Низкая | Высокий |

| Summary handoff | Веб-чат, смена задачи | Средняя | Высокий |

| Reference anchor | Любой длинный проект | Средняя | Очень высокий |

/fork ветвление | Исследование альтернатив | Средняя | Средний |

Полный сброс /clear | Критическая деградация | Низкая | Высокий |

| Декомпозиция задач | Планирование с нуля | Высокая | Максимальный |

Техника 5: Автоматическая компрессия — что нового в 2025–2026

Anthropic активно работает над встроенными решениями.

Когда диалог приближается к лимиту контекстного окна, Claude выполняет то, что называет «организацией мыслей». Вы увидите краткое сообщение об этом. Полная история чата сохраняется для справки — вы можете прокрутить назад и увидеть всё. Но рабочий контекст, используемый для генерации ответов, сжимается.

При каждой компрессии информация сжимается — причём не случайная информация, а часто именно те технические детали, которые важны больше всего. Чем больше циклов компрессии, тем размытее становится всё.

Claude Sonnet 4.6, Claude Sonnet 4.5 и Claude Haiku 4.5 получили контекстную осведомлённость. Эта возможность позволяет моделям отслеживать оставшееся контекстное окно (токен-бюджет) на протяжении всего разговора, что позволяет Claude выполнять задачи и управлять контекстом более эффективно.

Заключение: управление контекстом — ключевой навык

Drift длинных тредов — не слабость Claude. Это фундаментальная особенность того, как работают LLM. Большее контекстное окно не делает модель автоматически лучше. По мере роста количества токенов точность и скорость вспоминания деградируют — это явление известно как context rot. Поэтому курирование того, что находится в контексте, так же важно, как и того, сколько места доступно.

Практический итог:

- Используйте

/compactпроактивно — при 60% заполнения, не когда уже горит - Создайте reference anchor — краткий блок состояния проекта, который начинает каждый новый тред

- Декомпозируйте задачи — один тред, одна фаза работы

- Делайте осознанные handoff — не просто «продолжи», а структурированная передача контекста

- Следите за симптомами — повторы, расплывчатость, переспрашивание = сигнал к сбросу

Иногда правильный выбор — полный сброс сессии, а не компрессия. Если сессия значительно отклонилась, начать с чистого контекста и хорошего reference-файла быстрее, чем пытаться реабилитировать плохо заполненную сессию.

Context engineering — это навык, который отделяет пользователей Claude, получающих стабильно высокие результаты, от тех, кто жалуется на деградацию. И освоить его проще, чем кажется.

Источники

- reddit/r/ClaudeAI: Long Claude threads start strong, then drift….Here's how I've been handling it

- Ultimate Guide: Fixing Claude hit the maximum length for this conversation

- Context Rot: Why AI Gets Worse the Longer You Chat

- What Is the Context Window Limit in Claude Code? How to Manage It

- Context windows — Claude API Docs (Anthropic)