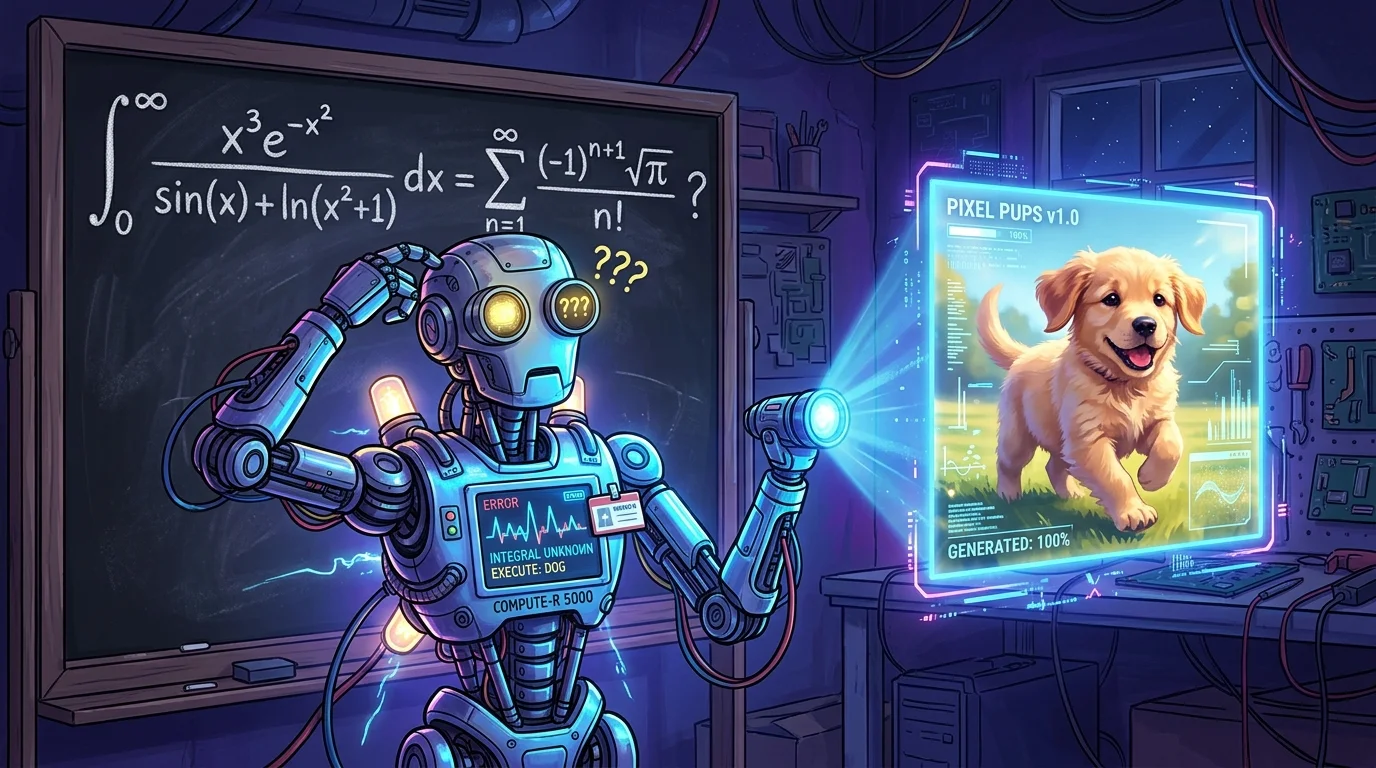

ChatGPT нарисовал собаку вместо интеграла

Пользователь попросил ChatGPT визуализировать горизонтальный интеграл — модель выдала изображение собаки. Разбираемся, что это такое и почему это происходит.

ChatGPT нарисовал собаку вместо интеграла

Пользователь Reddit попросил ChatGPT визуализировать горизонтальный интеграл (horizontal integral — математическая концепция интегрирования по горизонтальным сечениям). Вместо графика или диаграммы модель сгенерировала изображение собаки. Никаких упоминаний животных в чате не было — просто чистый математический запрос и… собака.

Что такое галлюцинация ИИ

То, что произошло с интегралом, — классический пример AI hallucination (галлюцинации ИИ). Галлюцинация возникает, когда генеративная система ИИ выдаёт данные, которые выглядят правдоподобно, но являются некорректными или бессмысленными.

Галлюцинации встречаются не только в текстовых моделях — они также происходят в генераторах изображений и видео, приводя к визуально неправдоподобным или контекстуально неточным результатам.

Языковые модели предназначены для предсказания наиболее подходящей строки текста или изображения вслед за вашим запросом — и если они не знают правильного ответа, могут с лёгкостью сгенерировать бессмыслицу, которая формально «подходит».

«ИИ не знает, является ли его вывод истинным. Галлюцинации — неизбежный побочный продукт LLM, пытающейся ответить на запрос подходящей строкой текста.» — Zapier Blog

Как это выглядит в цифрах

| Тип галлюцинации | Примеры | Частота |

|---|---|---|

| Текстовая | Несуществующие источники, выдуманные факты | Высокая |

| Визуальная | Лишние конечности, неверный объект на изображении | Средняя |

| Контекстная | Полностью нерелевантный ответ (как с собакой) | Редкая, но заметная |

Галлюцинации часто преподносятся моделью уверенно, что затрудняет их обнаружение пользователем.

Почему ChatGPT так поступил

Иногда алгоритмы ИИ производят результаты, которые не основаны на обучающих данных, неправильно декодируются трансформером или не следуют никакому распознаваемому паттерну.

Галлюцинации ИИ похожи на то, как люди иногда видят фигуры в облаках или лица на луне. В случае ИИ такие ошибки интерпретации возникают из-за переобучения, смещения данных и высокой сложности модели.

graph TD

A[Запрос: визуализировать интеграл] --> B{Обработка моделью}

B --> C[Нормальный путь: строит график]

B --> D[Сбой: активируется нерелевантный паттерн]

D --> E[Результат: изображение собаки]

C --> F[Ожидаемый результат]

Контекст: GPT-4o и генерация изображений

Лучшим генератором изображений в ChatGPT является GPT-4o — он бесшовно интегрируется в диалог и позволяет уточнять изображения через естественный разговор.

По данным OpenAI, с момента запуска обновлённого генератора изображений в марте более 130 миллионов пользователей создали свыше 700 миллионов изображений. При таких масштабах даже редкие сбои происходят регулярно — и именно поэтому скриншоты с нелепыми галлюцинациями так часто появляются на Reddit.

Практические советы при работе с ChatGPT:

- Формулируйте запрос максимально конкретно: указывайте тип графика, оси, диапазон значений

- Если результат неожиданный — попросите модель объяснить, что именно она изобразила

- Используйте итеративный подход: уточняйте промпт шаг за шагом

- Для математических визуализаций лучше работают явные инструкции: «нарисуй декартову систему координат, ось X от 0 до 5, покажи площадь под кривой f(x)=x²»

Значение для отрасли

Несмотря на постоянные обновления, ни один сервис не идеален, и есть вещи, с которыми генераторы изображений просто не справляются стабильно с первого раза.

Обнаружение и устранение ошибок и галлюцинаций представляет значительные трудности для практического внедрения и надёжности LLM в высокоответственных сценариях — от проектирования чипов до медицинской диагностики.

История с собакой и интегралом — комичная, но показательная иллюстрация фундаментальной проблемы: системы ИИ пока не могут знать, является ли их вывод истинным, поэтому технически галлюцинации — это не ложь. Это просто статистика, которая иногда идёт не туда.

Привлечение человека для проверки результатов ИИ остаётся последним барьером против галлюцинаций: если ИИ галлюцинирует, человек сможет отфильтровать и исправить ошибку.