NVIDIA VSS Blueprint: AI-аналитика видео на GPU

Обзор NVIDIA AI Blueprint для поиска и суммаризации видео: GPU-ускорение, VLM/LLM агенты, реальное время, плюсы и минусы, сравнение с Twelve Labs и AWS Rekognition.

NVIDIA AI Blueprint: Video Search & Summarization (VSS)

«Produce summaries of long videos up to 100X faster than going through the videos manually» — NVIDIA Build Portal

Что это и для кого

NVIDIA Blueprint for Video Search and Summarization (VSS) — это набор эталонных архитектур для построения vision-агентов и приложений видеоаналитики, объединяющих ускоренные видеомикросервисы, модели зрение-языка (VLM) и большие языковые модели (LLM). Проект размещён на GitHub под флагом NVIDIA-AI-Blueprints и находится в активном развитии — репозиторий насчитывает более 187 звёзд и 72 форка, последний релиз — v2.3.1.

Инструмент рассчитан на видеоаналитиков и IT-инженеров, занимающихся анализом и суммаризацией видеоданных: blueprint предлагает развёртывание в один клик, простое управление конфигурациями и plug-and-play модели. Для GenAI-разработчиков и ML-инженеров, которым нужна глубокая кастомизация, предусмотрены детальные конфигурационные опции, возможность дообучения LLM и замены компонентов пайплайна.

Типичные отрасли применения — производство, склады, умные города, реклама, безопасность.

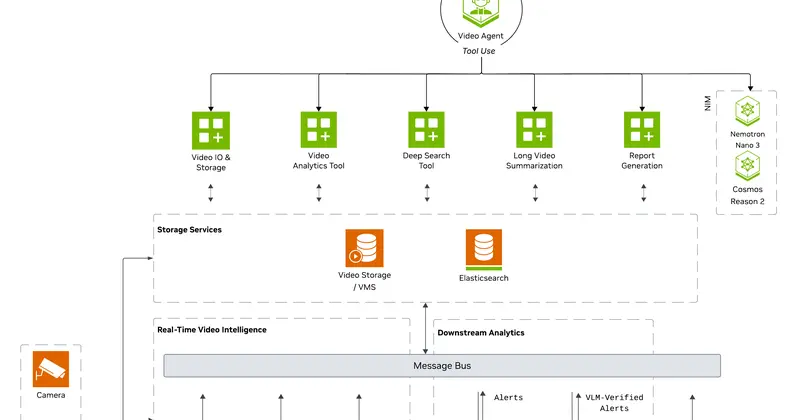

Архитектура: три слоя обработки

VSS организован в три области обработки: реальное время (извлечение признаков, эмбеддинги, понимание потока с публикацией результатов в брокер сообщений), аналитика downstream (обогащение метаданных до траекторий, инцидентов и верифицированных алертов) и агентная и офлайн-обработка (оркестрированные инструменты поиска, Q&A, суммаризации и клипового поиска, включая Model Context Protocol).

graph TD

A[Видеопоток / Архив] --> B[Real-Time Video Intelligence]

B --> C[Feature Extraction + Embeddings]

C --> D[Message Broker]

D --> E[Downstream Analytics]

E --> F[Trajectories / Incidents / Alerts]

D --> G[VectorDB + GraphDB]

G --> H[CA-RAG Module]

H --> I[VSS Agent MCP]

I --> J[Поиск по NL]

I --> K[Суммаризация]

I --> L[Q&A / Visual QA]

I --> M[Алерты]

Ключевые возможности

1. Суммаризация длинных видео (LVS)

С VSS пользователи могут суммаризировать видео в 100 раз быстрее, чем при ручном просмотре: например, часовое видео конвертируется в текстовый конспект менее чем за одну минуту.

Агент разбивает входное видео на сегменты, которые параллельно обрабатываются VLM-пайплайном для генерации детальных подписей к каждому фрагменту. Затем LLM рекурсивно суммаризирует эти подписи, формируя итоговое резюме всего видео.

2. Семантический поиск по видеоархиву

Workflow поиска позволяет отправлять запросы на естественном языке по видеоархивам для нахождения конкретных событий, объектов или действий. Используется многослойное получение и слияние эмбеддингов; после нахождения релевантных результатов агент критически оценивает клипы перед финальным ответом.

3. Алерты в реальном времени

Поддерживаются два workflow алертов: верификация алертов (VLM анализирует видеофрагменты, соответствующие алертам от компьютерного зрения) и алерты реального времени (VLM непрерывно обрабатывает сегменты из источника видео с заданными интервалами).

4. Context-Aware RAG (CA-RAG)

Плотные подписи, аудиотранскрипты и метаданные CV индексируются в векторные и графовые базы данных. Модуль CA-RAG использует Vector RAG и Graph-RAG как первичные источники для понимания видео — это применяется в ключевых функциях суммаризации, Q&A и отправки алертов.

5. Компьютерное зрение + аудио

Blueprint включает примеры использования CV-пайплайна с трекингом объектов, а также поддержку аудио.

6. Агентные skills (MCP)

Репозиторий содержит набор навыков (Skills) для работы с VSS; каждый поддиректорий в skills/ — самодостаточный skill по спецификации agentskills.io с именем, описанием, версией и лицензией. Среди них: управление алертами на стримах, запуск/отладка профилей, запросы к Elasticsearch через VA-MCP, поиск по архиву с VLM-критикой.

Пример кода: деплой через Docker

# 1. Клонирование репозитория

git clone https://github.com/NVIDIA-AI-Blueprints/video-search-and-summarization

cd video-search-and-summarization

# 2. Создание venv и установка зависимостей агента

curl -LsSf https://astral.sh/uv/install.sh | sh

uv venv --python 3.13

uv sync

source .venv/bin/activate

# 3. Сборка Docker-образа агента

docker buildx build --platform linux/amd64 \

-f agent/docker/Dockerfile \

-t vss-agent:latest --load .

# 4. Запуск через Docker Compose (базовый профиль)

docker compose --profile dev-profile-base up

Конфигурация агента задаётся через переменные окружения:

LLM_MODEL=nvidia/nvidia-nemotron-nano-9b-v2

VLM_MODEL=nvidia/cosmos-reason2-8b

VST_URL=http://HOST:30888

Тарифы и лицензирование

Использование моделей в blueprint регулируется NVIDIA AI Foundation Models Community License; на этапе preview действуют NVIDIA API Trial Terms of Service.

| Сценарий | Стоимость | Требования |

|---|---|---|

| Cloud Preview (build.nvidia.com) | Бесплатно (trial) | NVIDIA-аккаунт |

| Brev Launchable (AWS облако) | По тарифу облака (GPU-инстансы) | NVIDIA Developer |

| Локальный деплой | Бесплатно (open source код) | NVIDIA AI Enterprise лицензия для NIM |

| Продакшн с NIM | Коммерческая лицензия NVIDIA AI Enterprise | GPU H100/A100/L40s |

Для локального хостинга NVIDIA NIM требуется NVIDIA AI Enterprise developer licence. Стоимость самой лицензии AI Enterprise NVIDIA указывает через enterprise-продажи; публичного прайса нет.

Плюсы и минусы

| ✅ Плюсы | ❌ Минусы |

|---|---|

| GPU-ускорение: суммаризация в 100× быстрее ручного просмотра | Требует мощного NVIDIA GPU (мин. L40s для VLM) |

| Открытый исходный код на GitHub | Для продакшн-использования NIM нужна платная NVIDIA AI Enterprise лицензия |

| Поддержка MCP, агентных навыков, Docker/Helm/K8s | Высокий порог входа для DevOps-настройки |

| Работает с live-стримами и архивным видео | Привязка к экосистеме NVIDIA (GPU, NIM, Metropolis) |

| Готовые blueprint для склада и Smart City | Ограниченные облачные платформы: AWS поддерживается, Azure/GCP — в разработке |

| Поддержка аудио, трекинга объектов, Graph-RAG | Лицензия на тестовые данные ограничена 12 месяцами |

| Активно развивается: релизы выходят ежемесячно | Документация разрозненна по нескольким репозиториям |

| Проверенные кейсы: Pegatron, Incheon Airport, Kuala Lumpur | Требует технической экспертизы для кастомизации |

Сравнение с альтернативами

| Параметр | NVIDIA VSS Blueprint | Twelve Labs | AWS Rekognition Video |

|---|---|---|---|

| Тип | Self-hosted / Cloud Blueprint | SaaS API | Cloud API |

| Модели | Cosmos Reason 2 VLM + Nemotron LLM | Marengo + Pegasus | AWS-проприетарные |

| Семантический поиск | ✅ Multi-embedding + VLM-critique | ✅ Any-to-any search | ❌ Метки/теги, не семантика |

| Суммаризация | ✅ Chunking + LVS | ✅ Pegasus Generate API | ❌ Отсутствует нативно |

| Real-time стримы | ✅ Сотни потоков одновременно | ❌ Преимущественно архивное видео | ✅ Событийный стриминг |

| Graph-RAG / CA-RAG | ✅ Встроен | ❌ | ❌ |

| Бесплатный уровень | Trial (build.nvidia.com) | 10 ч индексации | 60 мин/месяц, 12 месяцев |

| Цена (платно) | Корпоративная лицензия + GPU | от $0,042/мин индексации | от $0,10/мин |

| Требует GPU | ✅ Обязательно | ❌ (SaaS) | ❌ (SaaS) |

| Кастомизация | Очень высокая | Умеренная | Низкая |

| Интеграция с MCP | ✅ | ❌ | ❌ |

На рынке видеоаналитики выделяются две лагеря: полнопроходные платформы вроде Mixpeek и Twelve Labs (от загрузки до семантического поиска) и модульные облачные API от Google, Microsoft и AWS. Twelve Labs обеспечивает самый простой путь к поиску по видео на естественном языке.

У Twelve Labs две ключевые модели: Marengo — мультимодальная модель эмбеддингов, захватывающая визуальный, аудио- и пространственно-временной контекст для поиска по видео, — и Pegasus — видеоязыковая модель для генерации текстовых выходов.

Amazon Rekognition Video отлично подходит командам, чьё видео уже хранится в S3 и чей стек завязан на AWS.

Вердикт: кому подойдёт?

NVIDIA VSS Blueprint — это не SaaS-сервис с красивым интерфейсом, а мощная инженерная платформа для организаций, которые:

- Уже имеют или планируют купить GPU-инфраструктуру NVIDIA (H100, A100, L40s, DGX Spark, Jetson Thor)

- Строят собственные производственные, городские или промышленные системы видеонаблюдения

- Хотят полный контроль над данными — без отправки видео в сторонний облачный API

- Нуждаются в реальном времени: сотни потоков одновременно, мгновенные алерты

- Готовы инвестировать время DevOps и ML-инженеров в настройку

Не подойдёт, если:

- Нет NVIDIA GPU — рассмотрите Twelve Labs или Google Video Intelligence API

- Нужен быстрый MVP без инфраструктурных затрат

- Команда небольшая и нет ресурсов на эксплуатацию k8s/Docker-стека

Рейтинг: 8.5 / 10

| Критерий | Оценка |

|---|---|

| Функциональность | 9/10 |

| Производительность | 10/10 |

| Простота старта | 6/10 |

| Стоимость владения | 6/10 |

| Экосистема и интеграции | 9/10 |

| Документация | 7/10 |

VSS — лучший выбор для enterprise-команд с GPU-инфраструктурой NVIDIA, которые строят серьёзные системы видеоаналитики с требованиями к real-time, конфиденциальности данных и масштабируемости.