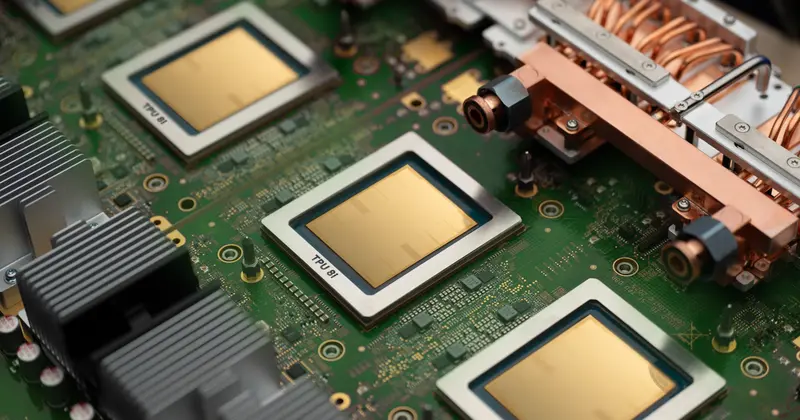

Google TPU 8t и 8i: два чипа для эпохи ИИ-агентов

Google представила TPU 8-го поколения: два специализированных чипа TPU 8t и TPU 8i для обучения и инференса в эпоху автономных ИИ-агентов.

Google TPU 8t и 8i: два чипа для эпохи ИИ-агентов

На конференции Google Cloud Next 2026 Google официально представила восьмое поколение своих фирменных процессоров TPU (Tensor Processing Unit — тензорный процессор для задач машинного обучения). Впервые в истории компания разделила архитектуру на два отдельных специализированных чипа: TPU 8t — для обучения моделей и TPU 8i — для инференса (inference — вывод, то есть работа уже обученных моделей в реальном времени). Это не просто обновление «железа» — это смена философии подхода к ИИ-инфраструктуре.

Почему понадобилось два чипа?

Вопрос не праздный. Раньше Google выпускала TPU с небольшими вариациями — суффиксами вроде «p» или «e» — но в основе всегда лежала одна архитектура. Теперь же впервые чипы различаются принципиально с самого начала разработки, а не являются модификациями одной основы.

Причина — кардинальное изменение ландшафта ИИ. По мере того как ИИ эволюционирует от однократных чат-ботов к автономным агентам, способным рассуждать, планировать и выполнять многошаговые рабочие процессы, Google разделяет инфраструктуру для двух принципиально разных задач: обучения и инференса.

Представьте себе типичный сценарий: вы просите ИИ-ассистента найти и забронировать авиабилеты, согласовать даты с вашим календарём и уведомить коллег. Агент должен делать всё это быстро, параллельно, не заставляя вас ждать. По мере перехода бизнеса от «простого ИИ» к «агентному ИИ», работающему в непрерывных циклах рассуждений, узким местом становится уже не просто вычислительная мощность, а пропускная способность памяти и задержка межчиповых соединений.

Нельзя возглавить эпоху агентов, опираясь на универсальное «железо». Именно поэтому появились два отдельных чипа с принципиально разными архитектурами.

TPU 8t: суперкомпьютер для обучения

TPU 8t — это «силовая установка» для обучения, специально разработанная для высокопроизводительных ИИ-задач. Он переопределяет масштаб разработки ИИ, обеспечивая почти трёхкратное увеличение вычислительной производительности по сравнению с предыдущим поколением, что позволяет сократить время обучения самых масштабных моделей.

Ключевые характеристики TPU 8t

В одном суперподе размещается 9 600 чипов, обеспечивающих 121 экзафлопс вычислений и два петабайта общей памяти, соединённых высокоскоростными межчиповыми интерконнектами (ICI).

Благодаря этому можно сократить месяцы обучения до недель, используя мощь кластера более чем из 1 миллиона TPU-чипов под управлением Pathways и JAX.

Что особенно важно — Google ввела технологии TPUDirect RDMA и TPU Direct Storage. TPUDirect RDMA обеспечивает прямую передачу данных между памятью и сетевыми картами, минуя хост-процессор и оперативную память, что снижает задержки. TPU Direct Storage также позволяет обходить хост-CPU и обеспечивает прямой доступ к памяти между TPU и высокоскоростным хранилищем, фактически удваивая пропускную способность при массовых передачах данных.

Понимая, что простой — это главный враг обучения на фронтире, TPU 8t спроектирован с целевым показателем «goodput» (продуктивного времени вычислений) более 97%.

TPU 8i: движок реального времени для агентов

Если TPU 8t — это «завод» по созданию умных моделей, то TPU 8i — это «нервная система», которая заставляет их работать мгновенно в продакшене.

TPU 8i создан для обработки «сложной, совместной, итеративной работы множества специализированных агентов», которые появляются с приходом агентного ИИ. Разработанный с повышенной пропускной способностью памяти для обслуживания чувствительных к задержкам нагрузок, TPU 8i масштабируется до 1 152 чипов в одном поде.

Ключевые характеристики TPU 8i

Чип оснащён в 3 раза большим объёмом SRAM-памяти на кристалле по сравнению с предыдущими версиями для размещения более крупных KV-кешей непосредственно на кристалле и интегрирует специализированный движок ускорения коллективных операций (Collectives Acceleration Engine, CAE).

Благодаря сокращению числа переходов для операций all-to-all (ключевых для MoE- и reasoning-моделей), топология Boardfly обеспечивает до 50% улучшения задержки для коммуникационно-интенсивных нагрузок.

В совокупности TPU 8i обеспечивает на 80% лучшую производительность на доллар для инференса по сравнению с предыдущим поколением, что позволяет миллионам одновременных агентов работать экономически эффективно.

Сравнение TPU 8t и TPU 8i

| Параметр | TPU 8t (обучение) | TPU 8i (инференс) |

|---|---|---|

| Основная задача | Обучение моделей | Инференс / агенты |

| Чипов в кластере | До 9 600 (суперпод) | До 1 152 (под) |

| Вычисления | 121 экзафлопс (FP4) | 11,6 экзафлопс (FP8) |

| Общая память | 2 ПБ HBM (суперпод) | 331,8 ТБ HBM (под) |

| SRAM на чип | — | В 3× больше, чем у Ironwood |

| Топология сети | 3D-тор (ICI) | Boardfly |

| Производительность/Вт | До 2× лучше Ironwood | До 2× лучше Ironwood |

| Прирост vs Ironwood | ~3× по вычислениям | ~80% лучше $/перф. |

Как это работает в связке: от обучения до агента

graph TD

A[Исходные данные и задача] --> B[TPU 8t: обучение модели]

B --> C[Обученная модель / чекпоинт]

C --> D[TPU 8i: деплой и инференс]

D --> E[ИИ-агент получает запрос]

E --> F[Рассуждение / планирование]

F --> G{Многошаговый воркфлоу}

G --> H[Шаг 1: поиск информации]

G --> I[Шаг 2: обращение к API]

G --> J[Шаг 3: генерация ответа]

H --> K[Результат для пользователя]

I --> K

J --> K

Чипы восьмого поколения — TPU 8t и TPU 8i — являются ответом на эти вызовы, гарантируя, что каждая задача, от первого токена обучения до финального шага многоходовой цепочки рассуждений, выполняется по наиболее эффективному пути.

Вирго-сеть и полный стек инфраструктуры

Сами чипы — лишь часть картины. Google дополняет кремний новой сетевой тканью Virgo Network для дата-центров, охладителями четвёртого поколения на жидкостном охлаждении, улучшениями Google Cloud Managed Lustre и оркестровыми улучшениями GKE, разработанными для агентно-ориентированных нагрузок.

С помощью Virgo Network и TPU 8t можно объединить 134 000 TPU в единую ткань в одном дата-центре, а более одного миллиона TPU — по нескольким площадкам в единый обучающий кластер, фактически превращая глобально распределённую инфраструктуру в один бесшовный суперкомпьютер.

Оба чипа — TPU 8t и 8i — работают на базе Axion, собственных ARM-процессоров Google, и поддерживают жидкостное охлаждение. Компания также оптимизировала эффективность всего стека, внедрив интегрированное управление питанием, которое адаптирует потребление в зависимости от нагрузки в реальном времени — это даёт до 2× лучшей производительности на ватт по сравнению с Ironwood.

Почему это важно: смена парадигмы

Решение разделить обучение и инференс отражает глубокий сдвиг на рынке. Несколько лет назад основные усилия были сосредоточены на обучении всё более крупных фундаментальных моделей. Теперь фокус расширился: нужно обслуживать эти модели в производстве, обрабатывая миллионы запросов, поддерживая длинные контексты и координируя специализированных агентов, работающих совместно. Google утверждает, что у этих задач настолько разные требования, что использовать одно и то же «железо» для обоих уже нецелесообразно.

С нашей точки зрения, этот «специализация прежде всего» дорожная карта подразумевает, что Google ожидает: рынок ИИ к 2027 году будет определяться роями агентов, требующих постоянного низкозатратного «воображения», а не лишь периодических масштабных прогонов обучения, характерных для ранней эпохи LLM.

Доступность и следующие шаги

Оба чипа станут общедоступны позднее в этом году и будут работать в рамках Google AI Hypercomputer — облачной суперкомпьютерной архитектуры, запущенной компанией в 2023 году, объединяющей высокопроизводительное оборудование, открытое программное обеспечение, фреймворки машинного обучения и гибкие модели потребления.

Восемь поколений TPU, более десяти лет разработки — и теперь Google делает ставку не на один универсальный чип, а на специализированную экосистему, созданную под конкретные этапы жизненного цикла ИИ.

Для российских разработчиков и компаний, работающих с облачными ИИ-решениями, анонс TPU 8t и 8i означает одно: инфраструктура для агентного ИИ стремительно взрослеет. Задачи, которые ещё недавно казались уделом научных лабораторий — миллионы одновременно работающих агентов, модели с триллионами параметров, мгновенный инференс — становятся инженерной реальностью.