TPU от Google: как работают чипы для самых тяжёлых задач ИИ

Разбираем архитектуру TPU от Google: от первого поколения до Ironwood и TPU 8-го поколения — зачем они нужны и чем лучше GPU.

TPU от Google: как специализированные чипы тянут всё более тяжёлые задачи ИИ

Когда вы задаёте вопрос Gemini, ищете что-то в Google или обрабатываете фотографии в Google Photos — за кадром работают особые процессоры, созданные специально для искусственного интеллекта. Их название — TPU (Tensor Processing Unit, процессор для тензорных вычислений). За последнее десятилетие они прошли путь от экспериментального внутреннего инструмента до одной из самых мощных AI-инфраструктур в мире.

Разберёмся, что это такое, как они устроены и почему сегодня TPU становятся стандартом для самых требовательных задач ИИ — от обучения огромных языковых моделей до работы тысяч автономных AI-агентов.

Что такое TPU и зачем он нужен?

TPU (Tensor Processing Unit) — это специализированная интегральная схема (ASIC), разработанная Google для задач машинного обучения на основе нейронных сетей. В отличие от универсальных GPU (графических процессоров) или CPU, TPU «заточен» под одну задачу — матричные вычисления, которые лежат в основе всех современных нейросетей.

TPU спроектированы так, чтобы повысить эффективность и снизить энергопотребление — за счёт фокуса именно на вычислительных потребностях ИИ и исключения операционных накладных расходов, характерных для универсальных архитектур.

Google начал использовать TPU внутри компании ещё в 2015 году, а в 2018 году открыл доступ к ним для сторонних разработчиков — как в составе облачной инфраструктуры, так и в виде отдельных чипов.

Сегодня TPU обеспечивают работу Gemini и всех AI-сервисов Google — поиска, Google Photos, Google Maps — которыми пользуются более миллиарда человек.

История поколений: от TPU v1 до восьмого поколения

Более десяти лет назад Google осознал необходимость создания первого в мире специализированного чипа для машинного обучения. В 2013 году началась разработка TPU v1 — первого в мире AI-акселератора такого рода.

Компания стартовала с TPU v1 в 2016 году как с процессора только для инференса (inference — запуск обученных моделей) для внутреннего использования, а затем последовательно добавляла возможности с каждым поколением: TPU v2 добавил поддержку обучения, TPU v3 получил жидкостное охлаждение для массивных pod-архитектур, а TPU v4 сосредоточился на энергоэффективности.

timeline

title Поколения Google TPU

2015 : TPU v1 — первый внутренний инференс-чип

2017 : TPU v2 — поддержка обучения + bfloat16

2018 : TPU v3 — жидкостное охлаждение, pod до 1024 чипов

2021 : TPU v4 — 2x производительность, energy efficiency

2023 : TPU v5p — конкурент Nvidia H100

2024 : Trillium (v6) — 4.7x прирост, Gemini 2.0

2025 : Ironwood (v7) — эпоха инференса, 42.5 ExaFLOPS

2026 : TPU 8t / 8i — специализация под обучение и инференс

Trillium (TPU v6): прорыв в производительности

Trillium достиг впечатляющего 4,7-кратного увеличения пиковой вычислительной производительности на чип по сравнению с TPU v5e. Кроме того, была удвоена ёмкость HBM-памяти (High Bandwidth Memory — высокоскоростная память с широкой шиной) и пропускная способность межчиповых соединений (ICI).

При этом Trillium стал и самым экологичным: он более чем на 67% энергоэффективнее TPU v5e.

Google использовал TPU Trillium для обучения Gemini 2.0 — на тот момент самой мощной AI-модели компании. Теперь та же инфраструктура доступна предприятиям и стартапам через Google Cloud.

Ironwood (TPU v7): первый чип для «эпохи инференса»

Мы переходим от реактивных AI-моделей, дающих информацию для интерпретации человеком, к моделям, которые проактивно генерируют инсайты и выводы сами.

На конференции Google Cloud Next 2025 была представлена Ironwood — седьмое поколение TPU, наиболее производительный и масштабируемый AI-акселератор Google на то время, и первый, разработанный специально для инференса.

Это то, что Google называет «эпохой инференса» (age of inference): AI-агенты будут проактивно получать и генерировать данные, совместно формулируя инсайты и ответы, а не просто передавая данные. Ironwood создан для поддержки этой новой фазы генеративного ИИ с её колоссальными вычислительными и коммуникационными требованиями.

Ключевые характеристики Ironwood

Ключевые параметры одного чипа: 4 614 TFLOPS в формате FP8, 192 ГБ памяти HBM3E, 7,37 ТБ/с пропускной способности памяти, 9,6 Тбит/с пропускной способности ICI. Полный суперпод из 9 216 чипов обеспечивает 42,5 ExaFLOPS вычислительной мощности.

Производительность на ватт у Ironwood в 2 раза выше, чем у Trillium предыдущего поколения. В условиях, когда доступная мощность является одним из ограничений для развёртывания AI-возможностей, это означает значительно большую вычислительную ёмкость для клиентских нагрузок.

С Ironwood можно масштабироваться до 9 216 чипов в одном суперподе. Эти чипы связаны прорывной сетью ICI (Inter-Chip Interconnect) с пропускной способностью 9,6 Тбит/с.

TPU 8-го поколения: специализация как философия

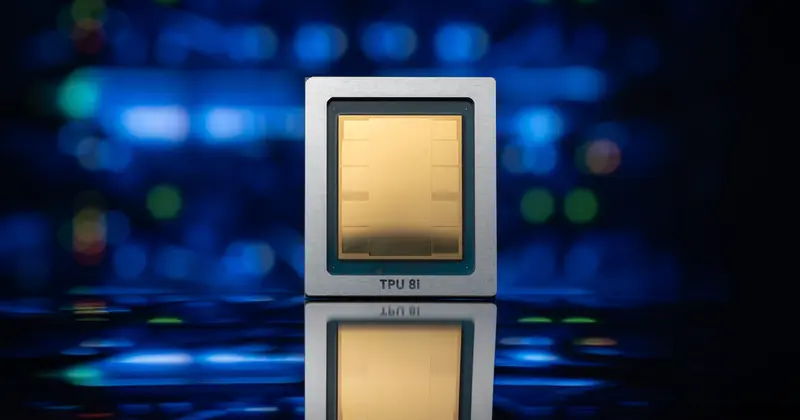

В апреле 2026 года Google представил восьмое поколение TPU — и впервые разделил чипы по задачам.

На конференции Google Cloud Next были представлены два варианта восьмого поколения TPU: TPU 8t и TPU 8i — с разными архитектурами для обучения и инференса.

Восьмое поколение разделило задачи обучения и инференса. Все предыдущие поколения представляли собой единый чип, отвечающий за обе задачи. Разделение на 8t и 8i признаёт, что эти два типа нагрузок предъявляют принципиально разные требования к аппаратному обеспечению.

TPU 8t — король обучения

TPU 8t — это мощный процессор для обучения, созданный для ускорения разработки сложных моделей.

TPU 8t создан для масштабного предобучения и нагрузок с высокой долей эмбеддингов при масштабе до 9 600 чипов в одном суперподе и обеспечивает улучшение производительности на доллар до 2,7x.

TPU 8i — скорость инференса

TPU 8i («Inference») предназначен для высокоскоростного обслуживания, работы AI-агентов и рассуждений с длинным контекстом. Он обеспечивает пиковую производительность 10,1 FP4 PFLOPs и оснащён 288 ГБ памяти HBM3e с пропускной способностью 8 601 ГБ/с. Объём встроенной SRAM составляет 384 МБ — это втрое больше, чем у предыдущего поколения.

TPU 8i вводит сетевую топологию «Boardfly» и движок ускорения коллективных операций (CAE), который снижает задержку синхронизации в пять раз.

Впервые оба чипа работают под управлением собственного CPU Axion на архитектуре ARM от Google, что позволяет оптимизировать всю систему целиком — не только сам чип — для максимальной производительности и эффективности.

Сравнение поколений TPU

| Поколение | Год | Ключевое новшество | Объём HBM | Пиковая производительность |

|---|---|---|---|---|

| TPU v1 | 2016 | Первый ASIC для ИИ | 8 ГБ DDR3 | ~92 TOPS (INT8) |

| TPU v2 | 2017 | Обучение + bfloat16 | 16 ГБ HBM | 45 TFLOPS |

| TPU v3 | 2018 | Жидкостное охлаждение | 32 ГБ HBM | ~105 TFLOPS |

| TPU v5p | 2023 | Конкурент H100 | 95 ГБ HBM | ~460 TFLOPS |

| Trillium (v6) | 2024 | 4.7x прирост vs v5e | 32 ГБ HBM | ~918 TFLOPS |

| Ironwood (v7) | 2025 | Эпоха инференса | 192 ГБ HBM3E | 4 614 TFLOPS |

| TPU 8t | 2026 | Специализация: обучение | 216 ГБ | 12.6 FP4 PFLOPs |

| TPU 8i | 2026 | Специализация: инференс | 288 ГБ HBM3e | 10.1 FP4 PFLOPs |

TPU vs GPU: что выбрать?

Вопрос «TPU или GPU?» сегодня актуален для многих инженеров и исследователей. Однозначного ответа нет — всё зависит от задачи.

TPU превосходят конкурентов в задачах инференса и тензорных операциях, обеспечивая в 4 раза лучшее соотношение цена/производительность для обслуживания LLM, генерации изображений и рекомендательных систем. GPU от Nvidia сохраняют превосходство для обучения разнообразных моделей, исследований, требующих гибкости, и нетензорных задач. Оптимальная стратегия — гибридная: TPU для production-инференса, GPU для экспериментов.

Энергоэффективность: козырь TPU

Google утверждает, что Ironwood почти в 30 раз эффективнее первого поколения TPU и обеспечивает значительно более высокую производительность на ватт, чем даже новейшие GPU. Для гиперскейлеров, обрабатывающих триллионы запросов в день, это напрямую трансформируется в операционную экономию, измеряемую сотнями миллионов долларов в год.

Реальные кейсы: кто уже использует TPU?

TPU используются для широкого круга AI-задач: работы агентов, генерации кода, больших языковых моделей, создания медиаконтента, синтетической речи, компьютерного зрения, рекомендательных систем и моделей персонализации.

Несколько показательных примеров:

AI-стартап Anthropic планирует использовать до 1 миллиона новых TPU для работы своей модели Claude.

Сервис генерации изображений Midjourney, долгое время работавший на GPU, перешёл на TPU в 2024 году и сократил расходы на инференс на 65% — с 2 миллионов до 700 тысяч долларов в месяц.

TPU также применяются для ускорения вычислительно интенсивных симуляций в структурной биологии, геномном секвенировании и разработке лекарств.

Ещё одно направление — физические агенты, взаимодействующие с реальным миром: TPU позволяют быстрее обучать роботов, автономных агентов и промышленные машины на синтетических и реальных данных.

Программный стек: с чем работает TPU

Помимо железа, важна и программная экосистема. Обе платформы — TPU 8t и TPU 8i — поддерживают нативные JAX, MaxText, PyTorch, SGLang и vLLM — фреймворки, которые разработчики уже используют — и предоставляют доступ к bare metal, позволяя клиентам работать напрямую с железом без накладных расходов виртуализации.

Для инференса Google недавно анонсировал расширенную поддержку TPU в vLLM, позволяющую разработчикам переключаться между GPU и TPU или использовать оба типа чипов с минимальными изменениями конфигурации. GKE Inference Gateway интеллектуально балансирует нагрузку между TPU-серверами, снижая задержку Time-to-First-Token (TTFT) до 96% и стоимость обслуживания до 30%.

# Пример запуска модели на TPU через JAX

import jax

import jax.numpy as jnp

# Инициализация устройств (TPU)

devices = jax.devices('tpu')

print(f"Доступно TPU-устройств: {len(devices)}")

# Простой пример параллельных вычислений

@jax.jit

def matrix_multiply(a, b):

return jnp.dot(a, b)

# Создаём матрицы на TPU

a = jnp.ones((1024, 1024))

b = jnp.ones((1024, 1024))

result = matrix_multiply(a, b)

print("Матричное умножение выполнено на TPU!")

Будущее TPU: к чему идёт Google

Google создаёт свои процессоры для прорывов в производительности, которые возможны только при глубоком, системном совместном проектировании — под одной крышей располагаются исследования моделей, разработка программного и аппаратного обеспечения. Именно так десять лет назад был создан первый TPU, который, в свою очередь, восемь лет назад открыл путь к изобретению архитектуры Transformer — той самой, на которой работает большинство современных систем ИИ.

Ironwood — результат непрерывного цикла в Google, где исследователи влияют на дизайн железа, а железо ускоряет исследования. В отличие от конкурентов, полагающихся на внешних поставщиков, когда Google DeepMind требует конкретного архитектурного усовершенствования для модели вроде Gemini, они напрямую сотрудничают с командой инженеров TPU.

Аппаратные циклы разработки значительно длиннее, чем программные. С каждым поколением TPU необходимо предвидеть, какие технологии и требования будут существовать к моменту выхода чипа на рынок.

Сегодня TPU — это не просто чипы для внутреннего использования Google. За последние месяцы Google активизировал усилия по всему стеку, чтобы вывести TPU к внешним клиентам через GCP или продавая полные TPU-системы как вендор — превращая поисковый гигант в действительно дифференцированного облачного провайдера.

Итог: зачем это знать?

TPU — это не абстрактная технология «для гигантов». Понимание того, как устроена AI-инфраструктура, помогает:

- Выбирать правильную платформу для своих задач — обучение или инференс, GPU или TPU

- Оценивать стоимость развёртывания AI в продакшне

- Следить за трендами — разделение чипов на специализированные (8t vs 8i) показывает, куда движется индустрия

- Планировать архитектуру приложений с учётом возможностей современного железа

Более десяти лет TPU обеспечивали наиболее требовательные рабочие нагрузки Google по обучению и обслуживанию моделей ИИ — и позволяли клиентам Google Cloud делать то же самое. И судя по темпам развития — от Ironwood до восьмого поколения всего за год — эта гонка только набирает обороты.